黄金时代持续疯狂输出,ChatGPT-4o升级版本闪亮登场~(资讯更新系列)

黄金时代持续疯狂输出,ChatGPT-4o升级版本闪亮登场~(资讯更新系列)

A:Hello,小麦(小Mi),请播报近期AI类新闻~

B:继ChatGPT 4.0之后,OpenAI推出ChatGPT-4o升级版本,并支持免费适用......

A:等等,新推的版本?小麦(小Mi),请详细介绍一下ChatGPT-4o。

B:o代表Omnimodel(代表全能模型之意),ChatGPT-4o 旨在提供更加自然和高效的人机交互体验。和之前的版本相比,ChatGPT-4o 新特性支持多模态交互:不仅能够处理文本,还能同时接受音频和图像输入,并生成相应的输出;支持情感理解,可以通过分析用户的表情和语气,判断其情绪......

为了帮助大家更好地了解大模型,今天MindSpore论坛坛主将直接整期着重介绍大模型第一梯队主力军ChatGPT及其最新版本ChatGPT-4o~首先我们将根据其发布时间简单介绍下ChatGPT各版本信息。

ChatGPT是OpenAI开发的一种人工智能语言模型,它有几个不同的版本,每个版本都在前一个版本的基础上进行了改进和扩展。以下是目前已知的ChatGPT的版本:

1. GPT-1:这是最初的版本,使用了Transformer神经网络架构,并在大量文本数据上进行预训练。它采用了自回归模型来预测下一个词的出现概率,并使用beam search算法生成文本。

2. GPT-2:在GPT-1的基础上进行了改进,增加了更多的参数(从1.5亿增加到15亿),以提高性能。GPT-2能够生成更长的文本,更好地处理对话,并具有更好的通用性。

3. GPT-3:拥有1750亿个参数,能够非常准确地执行语言翻译、问答和自动文本摘要等任务。GPT-3是一个开放模型,可供用户访问并进行迭代和改进。

4. GPT-3.5:基于GPT-3模型的改进版,在结构和数据集上进行了优化,使得其在聊天任务上表现更好,目前访问ChatGPT官网可以免费使用该版本。

5. GPT-4:ChatGPT4使用了更深、更大的模型,比ChatGPT3.5具有更强的语言理解和生成能力。此外,ChatGPT4采用了一种新的预训练方式,使得其可以更好地学习上下文信息,并且可以更好地利用大规模数据集进行训练。

6. GPT-4o:OpenAI的一小步,人类”AI助理”的一大步。与现有模型相比,GPT-4o 的最大进步在于,它可以实时对音频、视觉和文本进行推理——换句话说,它让ChatGPT实现了真正意义上的多模态交互。

不难看出,目前疯狂被大家追捧的GPT版本一定是GPT-4o了!那么接下来MindSpore论坛论主就来好好带领大家了解一下GPT-4o的最新特性!

1)OpenAI发布了名为GPT-4o的新模型,其中"o"代表"Omni",意味着全面或全体。GPT-4o是一个多模态模型,能够处理文字、语音、图片和视频,并且能够实时推理音频和视觉信息。

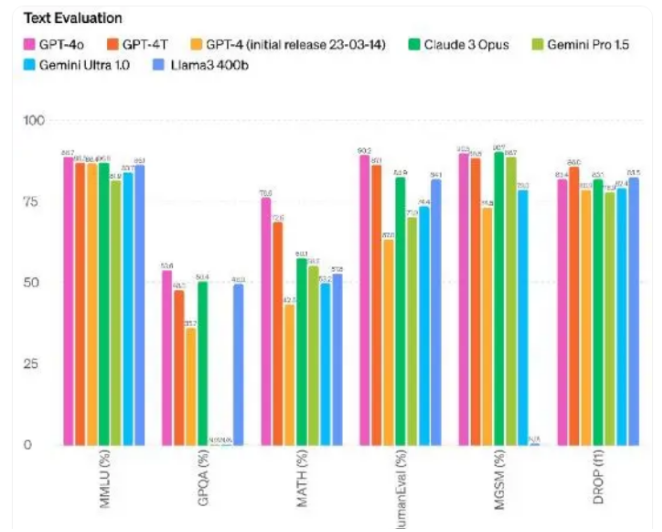

2)性能提升:GPT-4o在文本和代码能力上与GPT-4 Turbo相当,但在API响应速度上更快,价格更便宜50%。具体来说,速度提高了2倍,价格减半,限制速率提高了5倍。

3)响应快:基于GPT-4o的新ChatGPT(被称为Moss)在语音对话中几乎没有延迟,能够实时响应,甚至理解情绪和非语言的声音,如喘息和呼吸声。它还能够模拟不同的声音,包括机器人和唱歌的声音。

4)实时交互:能够进行直接的语音输入和输出,不再需要语音到文本的转换,5)视觉能力:还具备视觉能力,能够通过摄像头实时观察并理解所发生的事情。可以感知人的人的情绪,实时的和人对话。可以以视频的方式,感知我们写出来的数学题,并提供解决方式。同时,也可以辅助编程,简直是程序员的福音。

具体来说:

在5月14日的OpenAI春季发布会上,Mira Murati与团队成员Mark Chen和Barret Zoph共同展示了GPT-4o驱动的ChatGPT,突出了其在多种任务上的表现,特别是语音功能。简而言之,ChatGPT在搭载GPT-4o后,表现出了快速、全面和情感丰富的特点。用户在与ChatGPT交流时,可以随意打断对话,ChatGPT能够即时反应,避免了等待的尴尬。此外,当Mark表现出紧张和急促的呼吸时,ChatGPT能够察觉并建议他冷静下来,通过识别呼吸节奏来引导他进行深呼吸。

ChatGPT的即时翻译能力同样令人印象深刻,OpenAI团队在发布会上演示了英语和意大利语之间的无缝实时翻译,整个过程没有任何延迟。更有意思的是,ChatGPT在对话中不仅会使用情感丰富的语气词,还会与OpenAI团队进行幽默互动,表达感激之情。当它"看到"团队写下"I love ChatGPT"时,ChatGPT会以撒娇的语气回应,称赞他们”considerate”。

ChatGPT还具备与用户进行视频交流的能力。在一次演示中,Barret让ChatGPT尝试判断他的情绪状态。当他露出笑容时,ChatGPT立刻回应说:"You look very happy, with a big smile on your face and a hint of excitement.(你看起来非常开心,笑容满面,还带着一丝激动)"。

ChatGPT还具备与用户进行视频交流的能力。在一次演示中,Barret让ChatGPT尝试判断他的情绪状态。当他露出笑容时,ChatGPT立刻回应说:"You look very happy, with a big smile on your face and a hint of excitement.(你看起来非常开心,笑容满面,还带着一丝激动)"。

据 OpenAI 官网,GPT-4o 不仅在文本和代码处理的性能上与GPT-4 Turbo持平,而且在 API 调用上速度更快,价格更是降低了50%。

文本测试能力

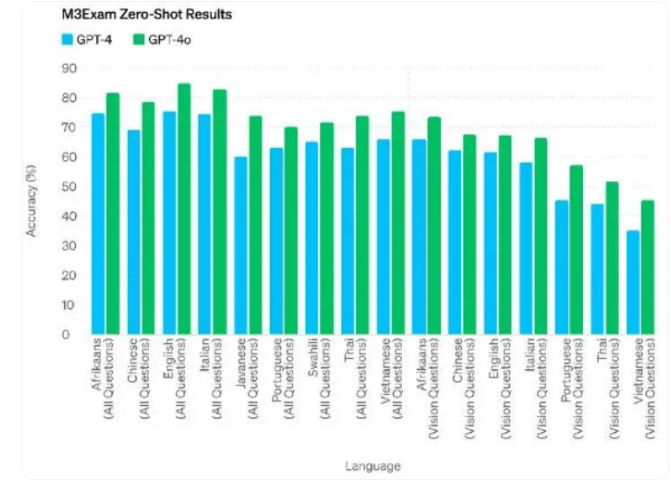

与GPT-4对比多语言考试能力

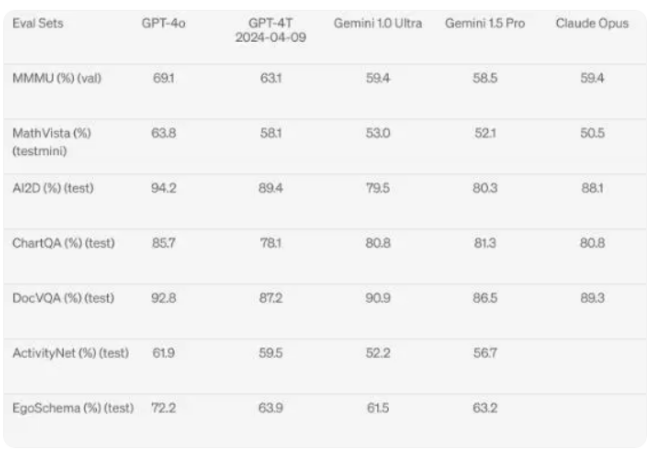

更重要的是,GPT-4o 的视觉理解能力在相关基准上取得了压倒性的胜利。

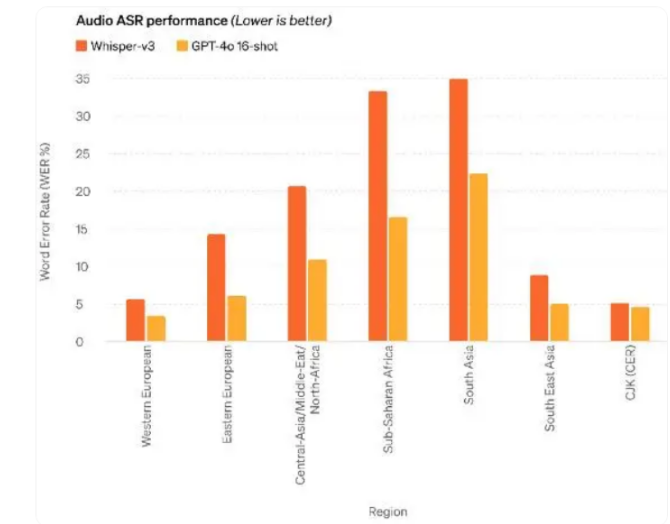

在音频方面,GPT-4o 的语音识别(ASR)也比 OpenAI 的语音识别模型 Whisper 性能更佳(越低越好)。

在音频方面,GPT-4o 的语音识别(ASR)也比 OpenAI 的语音识别模型 Whisper 性能更佳(越低越好)。

总的来说就是文字、语音、图片、视频统统来者不拒,还能实时处理音频和视觉信息超低的延迟,几乎可以做到真人级别的反应速度,甚至还要快。

总的来说就是文字、语音、图片、视频统统来者不拒,还能实时处理音频和视觉信息超低的延迟,几乎可以做到真人级别的反应速度,甚至还要快。

好啦,本期关于ChatGPT-4o的详细介绍就到这里啦,坛主在这里只能用一个词语来形容——extraordinary!我们下期继续不见不散!

好啦,本期关于ChatGPT-4o的详细介绍就到这里啦,坛主在这里只能用一个词语来形容——extraordinary!我们下期继续不见不散!