项目分享 | 基于MindSpore Serving实现大模型推理部署

项目分享 | 基于MindSpore Serving实现大模型推理部署

01

Why MindSpore Serving

大模型时代,作为一个开发人员更多的是关注一个大模型如何训练好、如何调整模型参数、如何才能得到一个更高的模型精度。而作为一个整体项目,只有项目落地才能有其真正的价值。那么如何才能够使得大模型实现落地?如何才能使大模型项目中的文件以app的形式呈现给用户?

解决这个问题的一个组件就是Serving(服务),它主要解决的问题有:

模型如何提交给服务;

服务如何部署;

服务如何呈现给用户;

如何应用各种复杂场景等待

昇思MindSpore Serving就是为了实现将大模型部署到生产环境而产生的。

昇思MindSpore Serving是一个轻量级、高性能的服务模块,旨在帮助昇思MindSpore开发者在生产环境中高效部署在线推理服务。当用户使用昇思MindSpore完成模型训练后,导出MindIR,即可使用昇思MindSpore Serving创建该大模型的推理服务。

昇思MindSpore Serving实现的是一个模型服务化的部署,也就是说模型以线上的形式部署在服务器和云上,客户通过浏览器或者客户端去访问这个服务,将需要进行推理的输入内容发送给服务器,然后服务器将推理的结果返回给用户。

02

Component

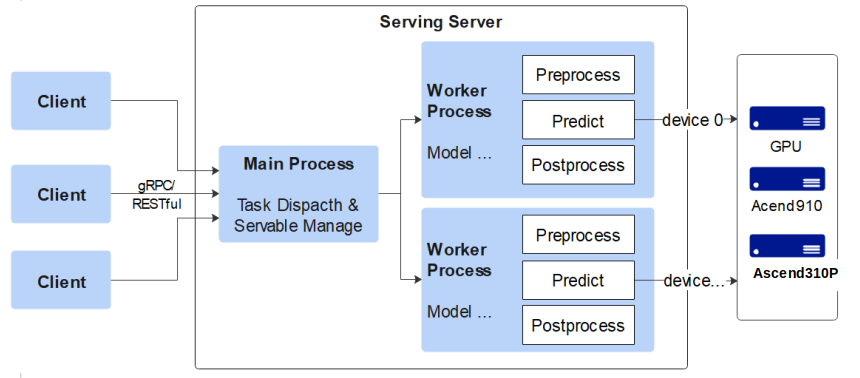

昇思MindSpore Serving由三部分组成,分别是客户端(Client)、Master和Worker。

客户端是用户节点,提供了gRPC和RESTful的访问。

Master是一个管理节点,管理所有Worker的信息,包括Worker有哪些模型的信息;Master也是一个分化节点,接收到了客户端的请求之后,会根据请求的内容,结合当前管理的Worker节点的信息进行分发,将请求分发给不同的Worker执行。

Worker是一个执行节点,会执行加载、模型的更新,在接收到Master转发的请求之后,会将请求进行组装和拆分,然后做前处理、推理和后处理,执行完之后将结果返回给Master,Master再将结果返回给客户端。

03

Features

1.简单易用:

对客户端提供了gRPC和RESTful的服务,同时又提供了服务的拉起、服务的部署和客户端的访问,提供了简单的python接口,通过python接口,用户可以很方便的定制和访问部署服务,只需要一行命令就能够完成一件事。

2.提供定制化的服务:

对于模型来说输入和输出一般是固定的,而对于用户来说输入和输出可能是多变的,这就需要一个预处理模块,将模型的输入转为一个模型可以识别的输入。同时还需要一个后处理模块,给用户提供定制化的服务,针对模型可以定制方法classifly_top,用户根据需要去写前处理和后处理的操作。对于客户端来说只要指定模型名和方法名就能实现推理的结果。

3.支持批处理:

主要是针对具有batchsize维度的文本来说。batchsize实现了文本的并行,在硬件资源足够的情况下,batchsize可以很大地提高性能。对于MindSpore Serving来说,用户一次性发送的请求是不确定的,因此Serving分割和组合一个或者多个请求以匹配用户模型的batchsize。例如batchsize=2,但是有三个请求发过来,这时候就会将两个请求合并处理,到后面再拆分,这样就实现了三个请求的并行,提高了效率。

4.高性能扩展:

昇思MindSpore Serving所使用的算子引擎框架是昇思MindSpore框架,具有自动融合和自动并行的高性能,再加上昇思MindSpore Serving本身具有一个高性能的底层通信能力,客户端可以进行多实例组装,模型支持批处理,多模型之间支持并发,预处理和后处理支持多线程的处理。客户端和Worker可以实现扩展的,因此它也实现了一个高扩展性。

04

Demo

基于昇腾训练处理器

start_agent.py

from agent.agent_multi_post_method import

from multiprocessing import Queue

from config.serving_config import AgentConfig, ModelName

if —name— == "—main—":

startup_queue = Queue(1024)

startup_agents(AgentConfig.ctx_setting,

AgentConfig.inc_setting,

AgentConfig.post_model_setting,

len(AgentConfig.AgentPorts),

AgentConfig.prefill_model,

AgentConfig.decode_model,

AgentConfig.argmax_model,

AgentConfig.topk_model,

startup_queue)

started_agents = 0

while True:

value = startup_queue.get()

print("agent : %f started" % value)

started_agents = started_agents + 1

if started_agents >= len(AgentConfig.AgentPorts):

print("all agents started")

break

# server_app_post.init_server_app()

# server_app_post.warmup_model(ModelName)

# server_app_post.run_server__app()