论文精读 | 基于昇思MindSpore的行人重识别和步态识别探究解决行人的换装问题

论文精读 | 基于昇思MindSpore的行人重识别和步态识别探究解决行人的换装问题

**作者:**李锐锋 |来源:知乎

论文标题

An In-Depth Exploration of Person Re-Identification and Gait Recognition in Cloth-Changing Conditions

论文来源

CVPR 2023

论文链接

https://ieeexplore.ieee.org/document/10204291

代码链接

https://gitee.com/chunjie-zhang/ccpg-cvpr2023

昇思MindSpore作为开源的AI框架,为产学研和开发人员带来端边云全场景协同、极简开发、极致性能、安全可信的体验,支持超大规模AI预训练,自2020年3月28日开源来已超过6百万的下载量。昇思MindSpore已支持数百篇AI顶会论文,走入Top100+高校教学,通过HMS在5000+App上商用,拥有数量众多的开发者,在AI计算中心、智能制造、金融、云、无线、数通、能源、消费者1+8+N、智能汽车等端边云车全场景广泛应用,是Gitee指数最高的开源软件。欢迎大家参与开源贡献、套件、模型众智、行业创新与应用、算法创新、学术合作、AI书籍合作等,贡献您在云侧、端侧、边侧以及安全领域的应用案例。

在科技界、学术界和工业界对昇思MindSpore的广泛支持下,基于昇思MindSpore的AI论文2023年在所有AI框架中占比7%,连续两年进入全球第二,感谢CAAI和各位高校老师支持,我们一起继续努力做好AI科研创新。昇思MindSpore社区支持顶级会议论文研究,持续构建原创AI成果。我会不定期挑选一些优秀的论文来推送和解读,希望更多的产学研专家跟昇思MindSpore合作,一起推动原创AI研究,昇思MindSpore社区会持续支撑好AI创新和AI应用,本文是MindSpore AI顶会论文系列第23篇,我选择了来自北京交通大学计算机与信息技术学院的张淳杰老师团队的一篇论文解读,感谢各位专家教授同学的投稿。

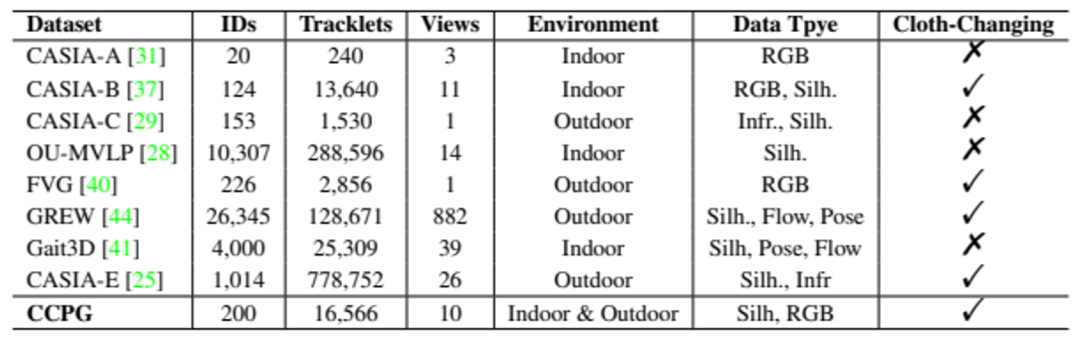

本文主要涉及行人重识别与步态识别相关问题,为了深入研究现实场景中的跨着装问题,我们收集并公开了第一个行人跨着装视频数据集,并提出了一种针对换装场景的步态识别方法,作为本数据集的对应标准方法。行人重识别与步态识别部分代码可以按照昇思MindSpore官方文档案例,或社区提供的目标检测相关代码和模型,可以轻松实现本文实验所需,十分方便快捷。

01

研究背景

随着深度学习的迅速发展,各种用于行人识别的技术实现了性能的提升,从理论走向了实际应用,为社会的稳定与和谐发展提供保障。其中,行人重识别和步态识别两种技术逐渐受到关注。这两种技术的目标几乎是一致的,即通过监控摄像头提供的图像和视频数据实现对目标行人的识别和匹配。然而,在实际应用中,行人重识别和步态识别面临诸多挑战,例如行人跨着装、遮挡、低质量图像等问题。虽然这两种方法已被应用于实际场景,并取得了一定的识别精度,但针对跨着装问题,关于二者识别精度的研究还欠缺。其中的原因是,行人重识别方法由于缺乏合适的视频数据集而导致相关研究较少;而步态识别研究往往局限于室内场景而不是室外场景,因为大多数步态数据集是在采集条件受控的实验室环境下采集的。为了深入研究现实场景中的跨着装问题,需要收集一个更适合的数据集,并基于该数据集进行系统的跨着装问题研究。

02

团队介绍

论文第一作者李唯嘉是北京交通大学计算机与信息技术学院23届硕士毕业生,研究方向为计算机视觉、步态识别等。

北京交通大学数字媒体信息处理研究中心(Mepro )肇始于1998年,2012年入选教育部“创新团队发展计划”。该中心现有教师14人,博、硕士研究生100余人。该中心的研究领域为数字媒体信息处理,研究方向主要包括图像\视频编码与传输、数字水印与数字取证、媒体内容分析与理解等。2022 年,实验室共发表高水平论文共 61 篇,其中包括本领域国际顶级汇刊 IEEE Trans.论文 38 篇,国际顶级会议如 NeurIPS、CVPR、ECCV、ACM MM 等论文 23 篇。

03

论文简介

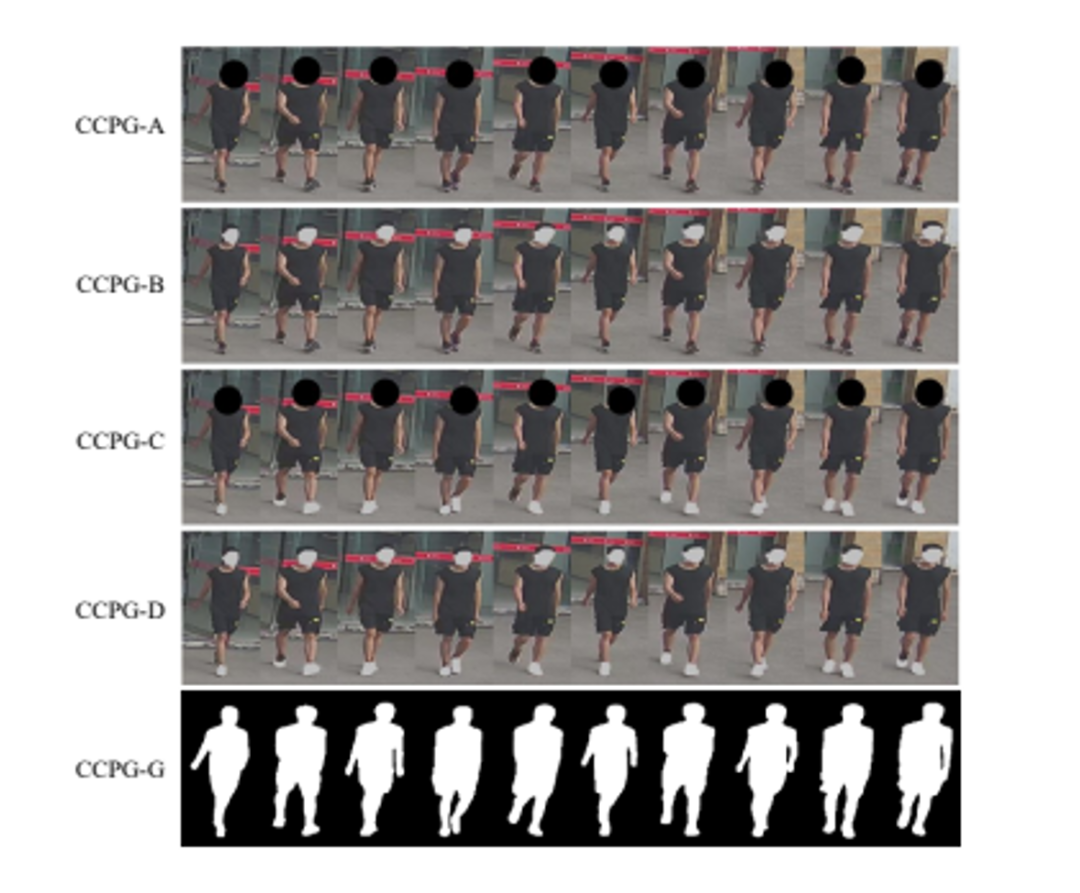

本文介绍了一项针对基于视频的行人重识别 (Person ReID) 和步态识别 (Gait Recognition) 技术的研究。这两项技术在视频监控分析中起着至关重要的作用,目标都是从不同的摄像头中识别目标行人。然而在实际应用中,换装的问题影响了它们的识别精度。当时鲜有工作研究此问题,究其原因是数据集的缺失。为了解决这个问题,我们提出了一个名为CCPG的基于视频的行人换装基准数据集,其中包含200个行人和超过16,000个行走序列。该数据集包括用于的RGB和剪影数据,包含了室内和室外场景下可能出现的各种换装情况,使其成为比较行人重识别和步态识别在换装条件下的Benchmark。相比于其他的数据集,本数据集的亮点是在换装类型和场景有着更为丰富的样本。

CCPG与其他数据集的对比

CCPG数据集及子数据集

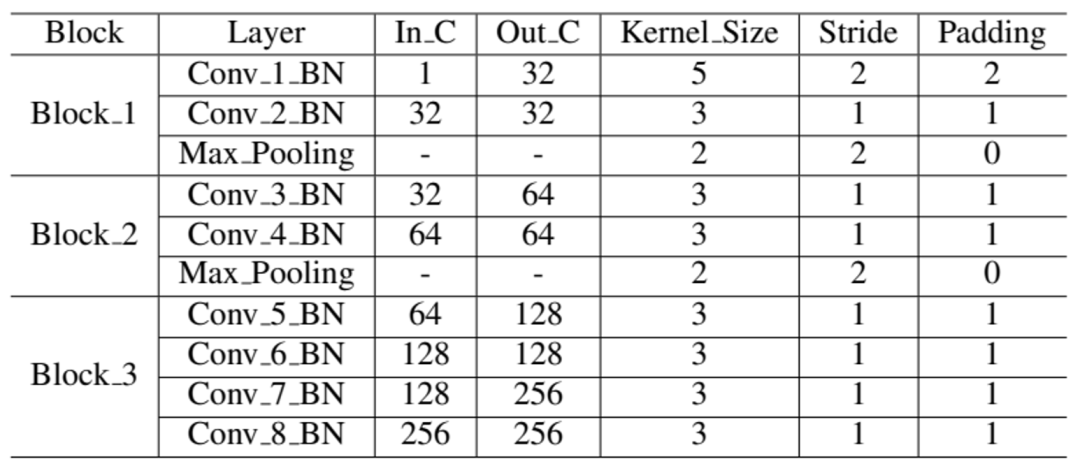

值得注意的是,我们还根据实战中鞋子区域与脸部区域信息的可得性,对这两个区域进行Mask的操作,得到了3个子数据集用于进一步的实验探索。最后我们使用CCPG数据集进行了一系列换装问题下行人重识别和步态识别方法的实验,证明步态识别在解决换装问题方面的优越性。另外,我们还提出的简单而高效的步态识别新方法AUG-OGBase在CCPG数据集取得令人满意的效果,进一步论证步态识别方法在解决换装问题中的潜力。

AUG-OGBase网络的设计

04

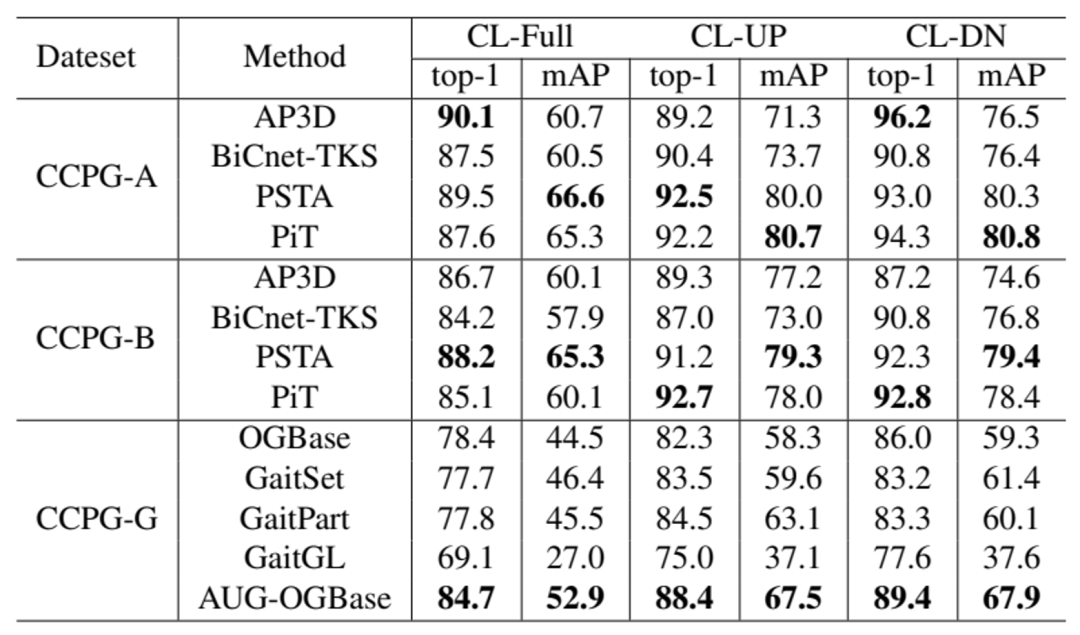

实验结果

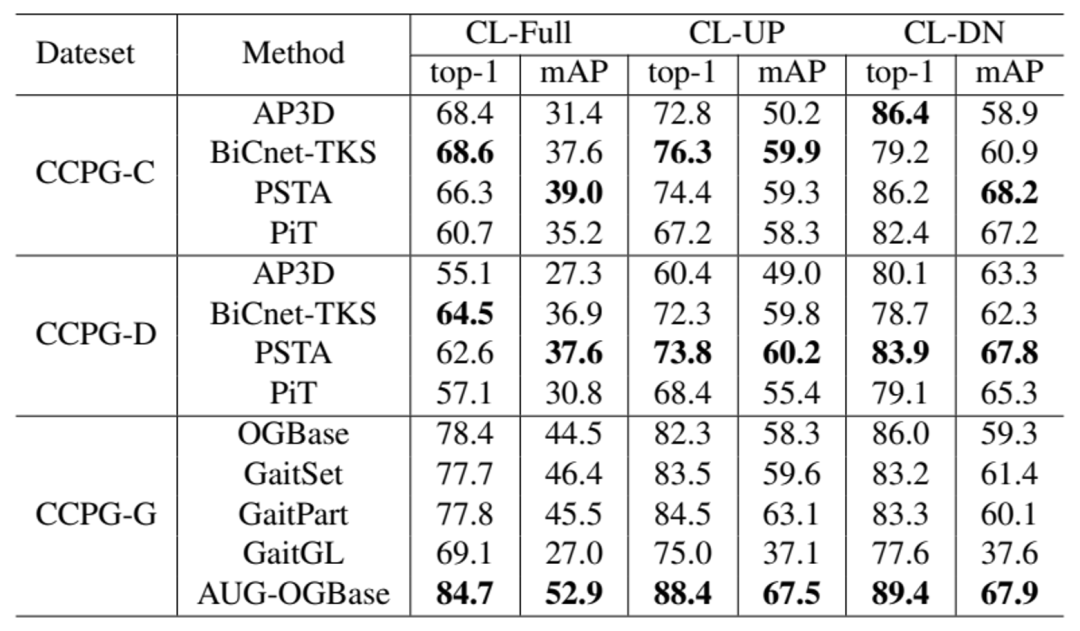

在CCPG数据集上,我们对比了经典的Video-Based ReID和Gait Recognition的方法,并且进一步对实验结果进行了分析研究。

实验表明,在鞋和脸区域信息可得的时候,ReID方法可以达到很高的识别精度。但是鞋外观不可得的情况下, ReID的性能会受到很大影响。换而言之, ReID还是基于外观信息在识别行人,缺少对于动态信息 (比如步态特征) 的识别,无法解决换装下识别精度下降的问题。这表明也ReID在解决换装问题方面存在局限性。

步态识别方法优于ReID 方法的原因主要是,步态识别方法更多地关注人体的空间静态和时间动态特征,而不太依赖于外观特征。所以在换装问题中,步态识别方法能够更好地利用与衣物无关的信息进行识别,达到更高的识别精度。同时也进一步说明对于解决换装问题,步态识别是一种具体潜力的技术路线。

05

总结与展望

主要介绍了一个名为CCPG的数据集,用于研究行人重识别和步态识别在换装问题下的表现。该数据集包含200个行人和超过16,000个行人序列,用于研究人物重识别和步态识别。文章还对使用CCPG数据集进行的实验进行了分析,结果显示步态识别在解决换装方面具有更高的潜力。文章提出的CCPG数据集和实验结果提供了为解决换装问题的提出了新方案,对现实世界中更好的社会安全技术的发展具有潜在贡献。

往期回顾

论文精讲 | 基于昇思MindSpore打造首个深度学习开源视频压缩算法库OpenDMC,支持跨平台和多种评价指标

论文精讲 | 基于昇思MindSpore的RGB-D显著性目标检测网络PICR-Net,准确高质量检测实物