MindSpore Transformers SIG成立:聚焦Transformer类大模型全流程开发与优化

MindSpore Transformers SIG成立:聚焦Transformer类大模型全流程开发与优化

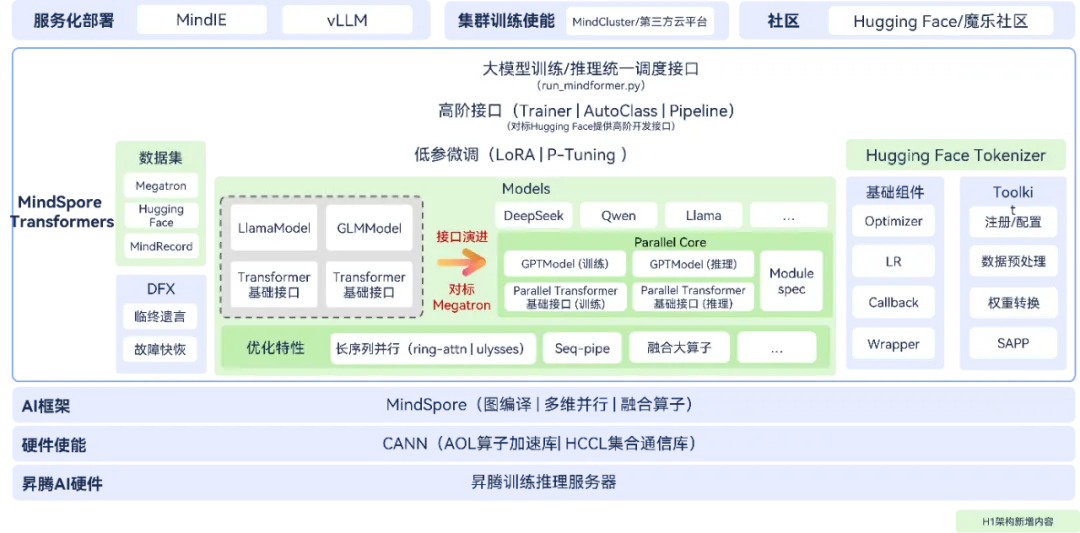

为了积极拥抱Hugging Face、Megatron-LM、vLLM等开源模型系统及训练推理框架生态,为用户提供高性能且易于使用的 MindSpore 大模型训练与推理能力,昇思MindSpore社区正式成立大模型套件SIG(MindSpore Transformers SIG)。SIG团队致力于提升Transformer类大模型在性能与易用性方面的表现,推动其在实际场景中的高效应用与落地。

MindSpore Transformers SIG 所涉及的技术领域主要包括以下方面:

**大模型开发迁移:**基于 MindSpore AI 框架和 MindSpore Transformers 大模型套件开发大模型,或迁移适配其他框架的优秀开源大模型至 MindSpore Transformers。

**高效大模型训练:**依托 MindSpore 的图融合、通信-计算掩盖、多维混合并行等技术,实现高性能的大模型训练;支持主流数据集格式,提供完备数据集特性;大集群训练高可用,故障自动检测、自动恢复。

**高效大模型推****理:**依托 MindSpore 的图融合、通信-计算掩盖、多维混合并行等技术,实现高性能的大模型推理;对接 MindSpore 金箍棒套件和 vLLM-MindSpore 插件,实现高效易用的大模型量化与服务化部署。

**大模型全流程易用性提升:**优化大模型全流程开发的易用性,提供清晰易用的生态资料;拥抱业界主流开源生态,无缝对接主流大模型训推框架、套件,提升大模型全流程开发迁移效率。

MindSpore Transformers大模型套件技术架构图:

MindSpore Transformers项目代码仓:

https://gitee.com/mindspore/mindformers

MindSpore Transformers SIG:https://gitee.com/mindspore/community/tree/master/sigs/mindspore\_transformers

MindSpore Transformers SIG 欢迎开发者参与共同推动 Transformer 大模型在 MindSpore 框架下的标准化、高效化与工程化,实现大模型全流程端到端能力的创新与落地,助力 AI 研发者与产业用户轻松构建与应用大模型。

当前SIG重点开发方向:

**1、关键功能与模块开发:**负责 MindSpore Transformers 项目核心功能模块的设计、开发与优化;编写高质量、可复用、可扩展的组件。

**2、模型开发与生态集成:**孵化或迁移优秀开源的模型或算法到 MindSpore Transformers;对接主流大模型生态社区与框架,维护对上下游库的兼容与集成。

**3、****测试、验证与标准化:**编写并维护单元测试、集成测试、性能测试、精度验证脚本;制定配置、输出结果的一致性和可复现性标准;输出可自动化的 CI/CD 流程。

**4、文档与示例:**编写用户文档、开发者手册、API 参考和快速上手教程;提供可执行示例、Notebook、参考配置;持续完善 FAQ 和使用指南。

上述开发方向欢迎感兴趣的开发者参与贡献!

SIG目标:

1、 聚焦大模型技术方向,推动关键技术演进

2、 建设可持续的开源生态

3、 推动贡献者协作与社区成长

4、 保障贡献代码质量与可用性

5、 推动成果落地与场景化应用

SIG例会:

月例会,每月第一个周四下午16点,欢迎感兴趣的开发者订阅SIG邮件:dev@mindspore.cn 及时获取会议通知。

首次例会录屏:

https://www.bilibili.com/video/BV1fL37zxE41/?vd\_source=a167ce7abbcf086a91bc3d842fcd9fc6

会议纪要:

https://etherpad.mindspore.cn/p/sig-MindSpore-Transformers-meetings

MindSpore Transformers SIG详情:

https://www.mindspore.cn/sig/MindSpore%20Transformers

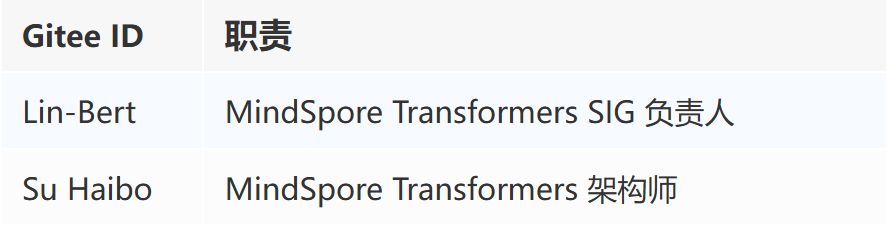

SIG成员:

Maintainer 列表

Committer列表

加入我们:

欢迎感兴趣的朋友们加入到MindSpore Transformers SIG,共同探讨动态图技术,可以添加小助手微信或扫描微信群二维码,入群讨论。欢迎您的围观和加入!